You're Fired. Kind of.

2월 27일 오후 5시 1분, 미국 정부는 Anthropic을 “공급망 안보 위협”으로 지정했다. 트럼프는 전 연방기관에 Claude 사용 즉시 중단을 명령했다. 같은 날 밤 OpenAI가 펜타곤과 계약서에 서명했다.

Also available on 애당초 4개의 시선 (Ethan Cho: Four Lenses on Everything) on Substack.

Read on Substack →2월 27일 오후 5시 1분, 미국 정부는 Anthropic을 “공급망 안보 위협”으로 지정했다. 트럼프는 전 연방기관에 Claude 사용 즉시 중단을 명령했다. 같은 날 밤 OpenAI가 펜타곤과 계약서에 서명했다.

19시간 후 이란 공격이 시작됐다.

WSJ은 보도했다. 그 작전에서 CENTCOM이 사용한 AI는 Claude였다고.

[](https://substackcdn.com/image/fetch/f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2Faac740bb-4091-4f15-ba94-e6eaf9fe9c81_1264x1638.heic)

---

이 모순이 많은 것을 설명한다

정리하면 이렇다. 1) Anthropic이 자율 살상 무기와 대규모 감시 사용을 거부했다. 2) 펜타곤은 계약을 파기했다. 3) OpenAI를 대안으로 서명했다. 4) 그리고 실전에서는 쫓아낸 Claude를 썼다.

“너는 마음에 안 들어서 내보낸다”고 선언하면서 “근데 전쟁에서는 네가 필요하다”는 구조다.

[](https://substackcdn.com/image/fetch/f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F7c607c8d-f10f-4737-a949-a6e3fcf37328_860x484.heic)

이 모순이 드러내는 건 세 가지다.

첫째, 이 교체는 처음부터 실제 교체가 목적이 아니었다. OpenAI 서명은 Anthropic을 압박하기 위한 협상 카드로 활용하려 했었거나, 교체를 원했지만 당장 기술적으로 불가능하다는 현실을 스스로 드러낸 것이다.

둘째, Claude가 군사 시스템에 이미 너무 깊이 통합돼 있어서 “금지”를 선언해도 뺄 수가 없었다. 아무도 그 결정을 내리지 않은 사이, AI가 국가 폭력 인프라의 기본값이 됐다. Operation Epic Fury는 그 사실이 처음으로 공개된 순간이다.

셋째, Anthropic 입장에서는 역설적으로 자신들의 가치가 증명됐다. 쫓아내겠다고 협박해도 실전에서는 결국 자기 것을 썼으니까.

---

Claude가 그 자리에 있게 된 이유

Anthropic은 2024년 말 Palantir를 통해 펜타곤 계약을 맺었다. 분류 네트워크에 접근한 최초의 AI 기업이었다. 이후 1월 마두로 체포 작전에서 처음 실전 투입됐다. 정보 분석, 타겟 식별 지원, 전투 시나리오 시뮬레이션. 그 결과가 검증됐기 때문에 이란 작전에서도 그대로 썼다.

군이 원하는 건 윤리적으로 올바른 AI가 아니다. 실전에서 작동하는 AI다. Claude는 두 번의 실전 데이터가 쌓인 유일한 AI였다.

OpenAI가 계약서에 서명한다고 내일부터 같은 성능을 분류 환경에서 낼 수 있는 게 아니다.

---

그럼 진짜 교체가 일어나는가

6개월이 관건이다. 계약상 전환 기간이 6개월이다. 이 기간 동안 OpenAI와 xAI가 분류 네트워크에서 충분히 검증되면 교체는 일어난다.

하지만 두 가지 변수가 있다.

하나는 이란 전쟁의 장기화다. 전쟁이 계속되면 작전 연속성이 중요해진다. 검증된 시스템을 교체하는 건 리스크다. 현장 지휘관은 새 AI를 실전에 처음 투입하고 싶지 않다.

다른 하나는 성능 차이다. 6개월 후 OpenAI 시스템이 분류 환경에서 Claude와 같은 수준이라고 검증되면 교체가 완성된다. 그렇지 않으면 “사실상 두 시스템 병행” 구조가 된다. 그리고 그 상태가 지속되면, 트럼프 행정부가 Anthropic에게 조용히 다시 손을 내밀 가능성도 있다.

다만 그때는 협상 레버리지가 Anthropic 쪽에 없다. 한 번 “공급망 위협” 낙인을 받은 상태에서 돌아오는 것과 처음부터 협상하는 것은 다르다.

---

Anthropic이 거부한 것의 본질

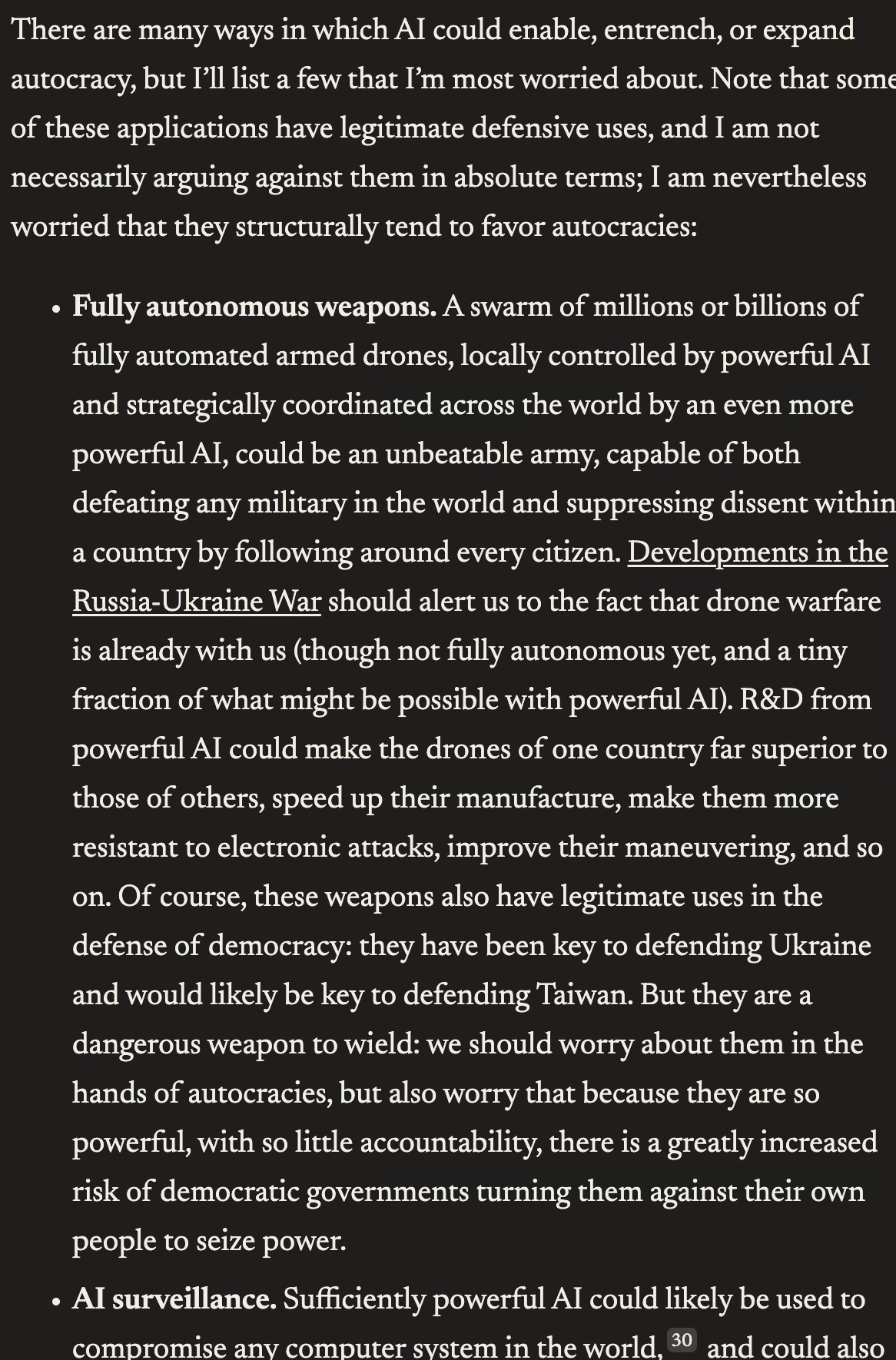

Amodei가 1월에 쓴 문장이 있다. “한 명 혹은 소수의 사람이 드론 군대를 다른 인간의 협조 없이 작동시킬 수 있는 구조를 가장 두려워한다.”

[](https://substackcdn.com/image/fetch/f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2Fcc8195d1-082a-4c8c-8e93-e4e0f6624619_1166x1770.heic)

이게 핵심이다. 윤리나 책임 문제가 아니다. 폭력의 마찰이 사라지는 것에 대한 두려움이다.

대규모 폭력에는 원래 마찰이 있었다. 전쟁을 일으키려면 수천 명의 군인을 동원해야 하고, 지휘 체계를 설득해야 하고, 물자 보급을 조직해야 한다. 각 단계마다 인간이 협조해야 한다. 그 마찰이 사실상 견제 장치였다. 독재자도 혼자 전쟁을 일으킬 수 없었다. 사람들을 움직여야 했으니까.

완전 자율 AI 무기는 그 마찰을 없앤다. 소수가 대규모 폭력을 인간 협조 없이 실행할 수 있게 된다. 의회가 검토하기 전에, 언론이 보도하기 전에, 여론이 형성되기 전에 일이 끝난다. 민주적 견제가 작동할 시간 자체가 없어진다.

Anthropic은 그 구조의 부품이 되기를 거부했다. 이란 공격 개시 결정은 새벽 2시 30분 트럼프의 Truth Social 영상 메시지로 세상에 알려졌다. 의회 승인 없었다. 사전 공개 토론 없었다. 인간의 마찰이 최소화된 전쟁이었다.

---

OpenAI는 그냥 굴복한 건가

이 지점에서 OpenAI를 단순히 “굴복”으로 보면 사태를 오독하게 된다.

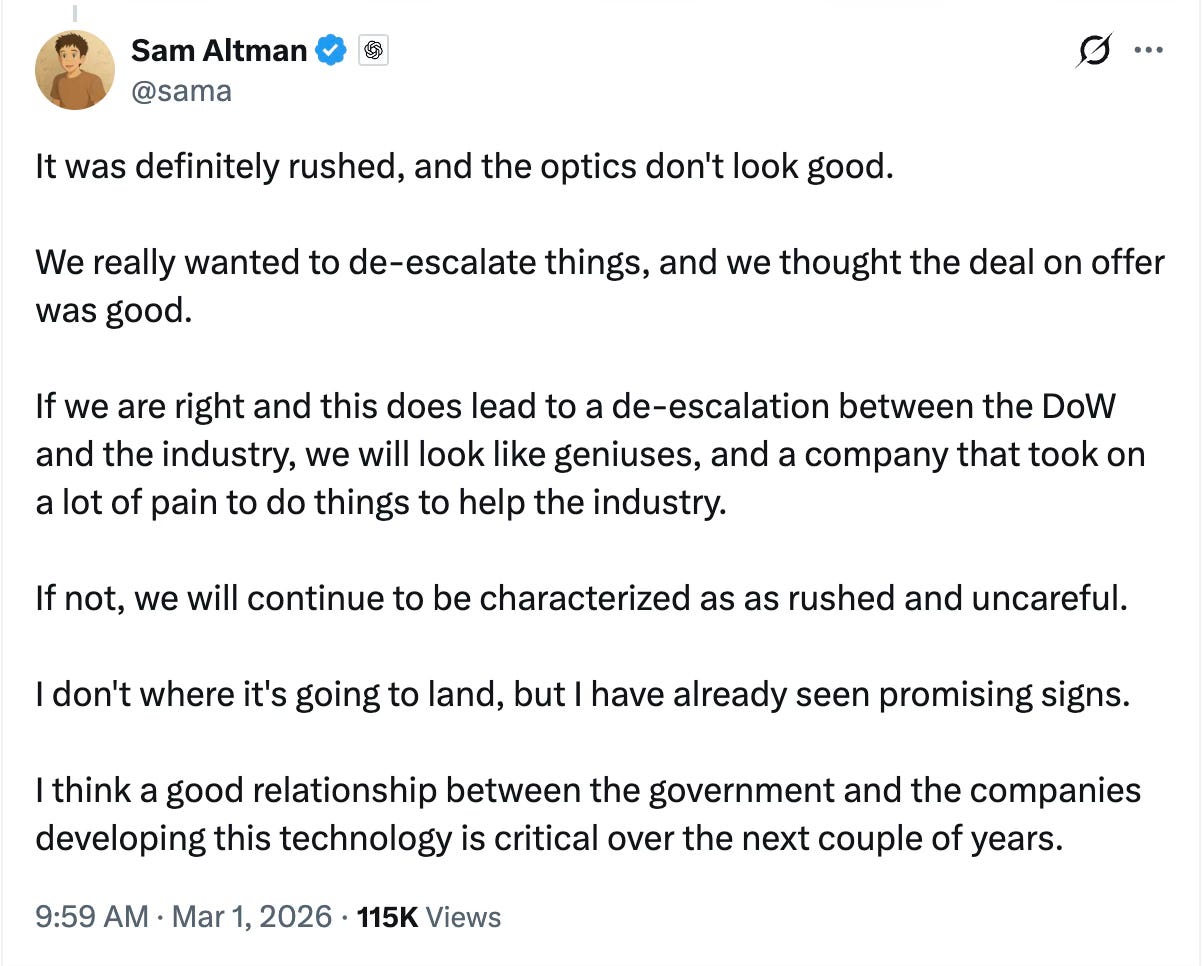

Sam Altman은 계약 후 공개 성명을 냈다. “우리도 자율 살상 무기와 대규모 감시는 금지한다.” 그리고 Anthropic의 블랙리스트 지정을 “매우 나쁜 결정”, “극도로 무서운 선례”라고 공개 비판했다. 경쟁사를 편든 것이다.

[](https://substackcdn.com/image/fetch/f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F51641d30-21fb-4cea-a316-751ce6287ce3_1202x966.heic)

차이는 구조였다. Anthropic은 Palantir를 통해 군 분류 네트워크에 직접 통합됐다. OpenAI는 클라우드 배포만 허용했다. 얼핏 보면 OpenAI가 더 신중한 것처럼 보인다. 하지만 반대다. 클라우드 너머 현장에서 자사 모델이 어떻게 쓰이는지 OpenAI는 볼 수 없다. 레드라인을 계약서에 아무리 잘 써놔도, 그 선이 지켜지는지 확인할 가시성이 없다. 더 깊이 들어갔던 쪽이 거부했고, 덜 들어간 쪽이 동의했다. Altman 본인도 이 딜이 “서둘렀고 optics가 좋지 않다”고 인정했다.

---

시장은 다른 판단을 내렸다

같은 날, Claude는 미국 앱스토어 1위를 찍었다. 1월 말 42위에서 한 달 만에 정상이다. ChatGPT가 2위로 밀렸다. 앱스토어 1~3위를 Claude, ChatGPT, Gemini가 동시에 점령한 것도 처음이다.

Anthropic이 공개한 수치를 보면, 올해 유료 구독자 2배 증가, 무료 유저 60% 증가, 일일 신규 가입 한 주 연속 역대 최고 기록.

정부가 “너는 위험하다”고 낙인찍은 순간, 소비자들은 반대로 움직였다.

심지어 무려 Katy Perry가 Claude 유료 구독을 인증하는 기염을 토했다.

[](https://substackcdn.com/image/fetch/f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F6af86d40-d87c-4b24-865b-43fbfbbcfee4_640x756.heic)

이게 지속될지는 모른다. 관심이 전환으로 이어지는지는 다음 분기 수치가 말해줄 것이다. 하지만 한 가지는 확실해졌다. AI 안전성이 소비자 선택의 실제 기준이 될 수 있다는 것. 정부의 탄압이 브랜드 자산이 될 수 있다는 것.

트럼프의 제재가 세상에서 가장 비싼 PR이 됐다.

---

이 이야기가 끝나지 않은 이유

이란 전쟁은 진행 중이다. 이란의 반격이 계속되고 있고, 두바이와 아부다비 공항이 피격됐다. 전쟁이 어디까지 가는지는 아무도 모른다.

그 전쟁에서 타겟을 식별하는 데 쓰인 AI의 회사는 지금 정부에서 쫓겨난 상태다. 그 AI는 쫓겨난 이후에도 실전에서 계속 돌아가고 있다. 그리고 소비자들은 그 회사의 앱을 역대 가장 빠른 속도로 다운로드하고 있다.

이 세 가지가 동시에 일어나고 있다는 게, 우리가 지금 어떤 시대에 진입하고 있는지를 보여준다.

정신이 하나도 없다.